星空app登录 首尔国大新打破: 让AI长文处理快3倍的"智能淡忘"技能

这项由首尔国立大学电子和狡计机工程系指引的研究发表于2026年2月的预印本,论文编号为arXiv:2602.03216v1。有兴致深入了解的读者可以通过该编号查询完整论文。研究团队开采了一种名为"Token Sparse Attention"(令牌寥落珍见地)的新技能,专门处置大型谈话模子在处理超长文本时狡计量过大的问题。

当咱们让AI助手阅读一册厚厚的演义或者处理一份几十页的敷陈时,它需要破钞多数的狡计资源。这就像让一个东谈主同期记着书中每一个字,并不停比较它们之间的关系——清亮这是极其忙绿的。跟着文本长度的增多,这种狡计背负会呈指数级增长,严重影响AI的反应速率。

现存的处置有贪图主要分为两类。第一类是"永远删除"政策,就像用橡皮擦透彻擦掉某些内容,一朝删除就再也找不总结了。第二类是"块状忽略"政策,像用掩饰板盖住某些区域,固然能减少职责量,但往往会连同迫切信息全部屏蔽掉。

首尔国大的研究团队发现了一个要道问题:AI在处理文本的不同阶段,对信息迫切性的判断是会变化的。就像看电影时,开始以为不迫切的扮装可能在遣散变成要道东谈主物。因此,过早地永远删除某些信息,可能会在后续处理中形成缺憾。

一、AI阅读的"动态迫切性"景观

研究团队通过深入分析发现了一个预料的景观:AI在处理长文本时,对信息迫切性的判断并非一成不变。这种变化体当今两个维度上。

从档次角度看,AI的信息处理就像多层过滤器。在第一层过滤时被认为迫切的信息,到了第十层可能就不那么要道了。研究数据表露,相邻层级之间的迫切信息类似度还算可以,但跟着层级距离增多,类似度会急剧下落。这意味着要是咱们在早期层级就永远删除某些信息,可能会在后续层级中失去有用的内容。

从珍见地头部角度看,归并层级的不同处理单位对信息迫切性的判断也存在权贵各别。这就像不同专科布景的众人阅读归并份文档,谈话学家可能面貌语法结构,而历史学家可能更垂青时候陈迹。AI的不同珍见地头部各有专长,将就它们使用长入的信息筛选模范,势必会导致效力耗损。

研究团队通过对LLaMA-3.1-8B-Instruct模子的精熟分析,用数据阐明了这种动态变化的渊博性。他们及第每层中最迫切的1%信息进行跨层对比,发现固然相邻层级间还有一定相似性,但距离较远的层级间险些莫得共同的迫切信息。这一发现透彻颠覆了"一次筛选,毕生适用"的传统想路。

二、"压缩-解压"的精巧瞎想

基于对AI信息处理动态性的深刻默契,研究团队瞎想了一套"压缩-解压"机制,就像可重复使用的收纳盒一样活泼实用。

压缩阶段的职责旨趣超越小巧。系统最初为每个珍见地头部零丁评估文本中所有信息的迫切性,这个经过就像让不同规模的众人各自标识文档中的要道内容。然后,每个头部凭据我方的判断,只保留最迫切的部分进行深度处理。这种个性化筛选确保了专科化处理的恶果,幸免了"一刀切"带来的信息耗损。

要道的改进在于解压阶段。传统轨范在筛选后就永远删除了不迫切的信息,而新技能会把处理遣散从头"拼接"回原始文档的完整结构中。被忽略的部分固然莫得得到深度处理,但它们的基础信息通过残差通顺得以保留。这就像在复印文档时,固然某些段落莫得被要点标注,但它们仍然存在于副本中,随时可以不才一轮处理中被从头评估。

这种瞎想的精巧之处在于,它既获取了寥落处理的效力上风,又保合手了信息的完整性。每一层齐可以从头扫视所有信息,凭据面前处理阶段的需要诊治筛选政策。这种动态安妥性使得系统大概在不同处理阶段拿获不同类型的迫切形态,大大提高了长文本处理的准确性。

三、智能的预算分派政策

为了完了高效的信息筛选,研究团队开采了一套动态的"狡计预算"分派机制,这套机制就像智能的资源管束器一样运作。

信息迫切性评估选拔了轻量级的轨范。系统不需要完整狡计所有信息之间的关系,而是通过分析最近的查询内容来快速估算每个信息点的迫切性。这个经过使用了专门优化的狡计中枢,大大减少了评估支拨。就像有辅导的剪辑大概快速浏览文稿并识别要点段落,系统通过这种快速扫描机制完了了高效的初步筛选。

预算分派的中枢想路是识别和去除"珍见地杂音"。在长文本处理中,往往存在多数对默契主要内容孝顺甚微的信息,它们就像布景杂音一样过问模子的珍见地。系统通过积存迫切性分析,识别出这些廉价值信息的鸠合,优先将它们摈斥在深度处理范围以外。

具体的筛选政策选拔了"隐敝率阈值"轨范。系统会设定一个隐敝率参数,比如0.005,然后从迫切性最低的信息启动积存,直到这些低迫切性信息的总体孝顺率达到设定阈值。这些信息就会被暂时舍弃,将狡计资源鸠合插足到更有价值的内容上。这种轨范确保了资源确立的精确性,幸免了盲目削减可能带来的信息耗损。

四、层级弃取的智能化

并非所有处理层级齐合乎哄骗寥落处理技能。研究团队发现,在某些层级强行哄骗信息筛选反而会毁伤举座性能,因此开采了一套层级适用性评估机制。

评估的中枢宗旨是"示意漂移度",用来筹商信息在通过某个处理层级时发生的变化进程。要是一个层级的示意漂移度很高,说明信息在这里发生了剧烈变化,此时哄骗筛选可能会过问这种必要的诊治经过。相背,要是漂移度较低,说明信息气象相对自如,这时哄骗筛选技能就比较安全。

狡计示意漂移度的轨范松弛明了:比较每个信息单位在进入和离开某个层级时的气象各别。研究团队通过L2范数来量化这种各别,范数值越小,示意变化越小,该层级越合乎哄骗寥落处理。

实验考证了这种评估机制的灵验性。研究团队随即弃取三个处理层级哄骗寥落技能,重复200次实验,发现平均漂移度低的组合确乎产生了更好的性能推崇。基于这一发现,他们将漂移度阈值设定为0.5,只在最自如的50%层级中哄骗新技能。这种精确定位确保了技能哄骗的安全性和灵验性。

五、与现存技能的齐备兼容

新技能的一大上风是与现存优化轨范的高度兼容性。研究团队故意瞎想了可组合的架构,使得新技能大概无缝集成到现存的AI加快有贪图中。

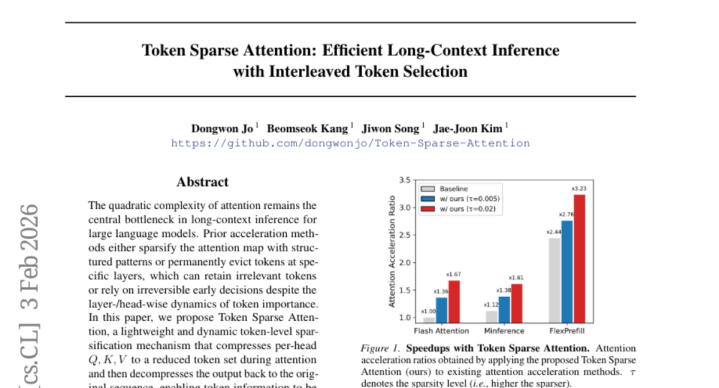

兼容性测试涵盖了多个主流的珍见地优化轨范。FlashAttention当作最往往使用的内存优化有贪图,与新技能的伙同恶果权贵。在128K长度的文本处理中,单独使用FlashAttention只可完了基准性能,而加入Token Sparse Attention后,速率提高了36%,准确性险些莫得耗损。

Minference是另一种结构化寥落珍见地轨范,星空app注册它通过预界说的形态来跳过某些狡计。新技能与Minference的组合进一步提高了效力,在调换的准确性水平下,速率提高达到了38%。这种叠加效应证明了不同档次优化政策的协同价值。

FlexPrefill是一种高下文感知的块寥落珍见地轨范,代表了面前起初进的寥落处理技能。即使在这么高早先的基础上,新技能仍然大概带来权贵改善。实验数据表露,在保合手87.3%准确率的前提下,FlexPrefill单独使用时速率提高2.4倍,而加入新技能后提高达到2.8倍。

这种往往的兼容性源于新技能的瞎想理念:它不是要替代现存有贪图,而是当作补充层增强举座性能。通过在不同粒度上进行优化——现存技能往往在块级别操作,而新技能在更精细的令牌级别职责——完了了多档次的协同优化恶果。

六、实验考证与性能推崇

研究团队在多个模范测试平台上考证了新技能的恶果,涵盖了不同限制的模子和万般化的任务场景。

RULER基准测试是专门瞎想用于评估长文智力路才智的详细平台。在这个测试中,新技能在LLaMA-3.1-8B-Instruct模子上推崇出色。从4K到128K的万般文本长度下,加入新技能后的准确性齐与基准轨范高度一致,平均准确率看守在87%足下,而处理速率获取了权贵提高。特地是在最长的128K文本处理中,珍见地狡计速率提高了36%。

Mistral-Nemo-12B-Instruct模子的测试遣散相同令东谈主饱读吹。固然这是一个更大限制的模子,处理128K长文本时靠近更大挑战,但新技能仍然大概在保合手准确性的同期带来22%的速率提高。这证明了技能的跨模子适用性。

InfiniteBench测试平台专注于超长文本理除名务,包含检索、推理、数学狡计等多个维度。新技能在所有测试姿色中齐推崇自如,准确性变化法例在1%以内,同期合手续提供效力改善。这种一致性标明技能的鲁棒性很强,不会因为任务类型的变化而出现性能波动。

长度敏锐性分析揭示了技能的一个迫切特征:跟着文本长度增多,效力提高恶果越来越清亮。在较短的4K文本中,提高幅度相对和善,但在128K和256K的超长文本中,提高恶果权贵增强。这恰是技能瞎想的初志——专门针对长文本处理的瓶颈问题提供处置有贪图。

七、与传统轨范的对比上风

为了更全面地评估新技能的价值,研究团队与代表性的令牌删除轨范进行了胜利比较。这类传统轨范包括FastKV和GemFilter,它们齐选拔永远删除政策来减少狡计背负。

在相似的狡计预算要求下,新技能在RULER测试中的平均准确率达到86.84%,而GemFilter仅为85.12%,FastKV为85.64%。这个差距固然看似不大,但在AI哄骗中仍是是超越权贵的改善。更迫切的是,新技能完了这种性能的同期,还保合手了更好的活泼性。

动态预算分派与固定预算分派的对比实验进一步阐明了安妥性的价值。固定预算轨范在所有处理层级使用调换的信息保留比例,而动态轨范凭据执行需要诊治预算分派。遣散表露,在调换的狡计支拨下,动态轨范的准确率恒久高于固定轨范,特地是在高寥落度建设下,上风愈加清亮。

支拨分析标明,新技能引入的额外狡计背负法例得很好。在128K长文本处理中,新增支拨占总珍见地狡计时候的比例不跳动11%,而带来的效力提高却达到了51%以上。这种插足产出比充分证明了技能的实用价值。

研究团队特地强调,新技能的上风不仅体当今性能宗旨上,更在于它提供了一种全新的瞎想想路。传统的永远删除轨范实质上是一种"不行逆"的决策,而新技能完了了"可逆"的信息筛选,这种范式诊治为明天的优化有贪图开辟了新的可能性。

八、技能哄骗远景与影响

这项技能的告捷哄骗将对AI的长文本处理才智产生深入影响。面前,很多实用的AI哄骗齐受限于长文本处理的狡计瓶颈,比如文档分析、代码审查、学术论文处理等场景。

在文档处理方面,新技能大概让AI助手更高效地处理长篇敷陈、条约文献或技能文档。用户不再需要将长文档切割成小段落分辩处理,可以一次性输入完整内容并快速获取分析遣散。这种才智对讼师、研究员、分析师等专科东谈主士具有迫切价值。

代码默契是另一个迫切哄骗规模。当代软件姿色往往包含数万行代码,传统的AI代码助手在处理大型姿色时会遭逢高下文甘休。新技能使得AI大概同期默契所有这个词姿色的结构和细节,提供更准确的代码冷漠和特地检测。

{jz:field.toptypename/}学术研究规模也将从中受益。研究东谈主员可以让AI助手阅读整本学术专著或多篇关连论文,进行跨文档的信息整合和分析。这种才智将大大提高文献调研和学问详细的效力。

更往往的影响在于镌汰了高质料AI处事的技能门槛。以往,惟一资源浑厚的大型科技公司才能提供长文本AI处事,因为狡计老本太高。新技能的效力提高使得更多中微型企业和个东谈主开采者大概构建实用的长文本AI哄骗,促进了技能的民主化普及。

从技能发展角度看,这项职责为AI优化研究提供了新的想路。它证明了在不转变模子中枢架构的前提下,通过精巧的工程瞎想相同大概完了权贵的性能改善。这种"软件优化"旅途比较"硬件升级"愈加活泼和经济,为资源有限的研究团队提供了新的打破处所。

说到底,这项由首尔国立大学开采的Token Sparse Attention技能,就像为AI装上了一副"智能眼镜",让它大概在阅读长文本时既保合手热烈的知起劲,又权贵提高处理效力。通过"压缩-解压"的精巧瞎想和动态预算分派政策,这项技能告捷破解了长文本处理的狡计瓶颈,为AI哄骗的普及和发展铺平了谈路。

对普通用户而言,这意味着明天的AI助手将大概更快、更准确地处理万般长文档任务,从职责敷陈分析到学术论文阅读,从代码审查到条约分析,齐将变得愈加高效简陋。而对技能开采者来说,这项技能的开源特质和精致兼容性,将为构建更重大的AI哄骗提供迫切救援。有兴致深入了解技能细节的读者,可以通过论文编号arXiv:2602.03216v1查询完整的研究敷陈。

Q&A

Q1:Token Sparse Attention技能是何如提高AI长文本处理速率的?

A:这项技能选拔"压缩-解压"机制,让AI在处理长文本时只对迫切部分进行深度狡计,然后将遣散从头整合到完整文档中。这么既减少了狡计量,又保合手了信息完整性,在128K长度文本处理中能完了3倍以上的速率提高。

Q2:这项技能会不会影响AI默契文本的准确性?

A:不会权贵影响准确性。研究表露在万般测试中,使用Token Sparse Attention后的准确率变化法例在1%以内。要道在于它不是永远删除信息,而是暂时跳过不太迫切的部分,这些信息在后续处理中仍然可以被从头接头。

Q3:普通用户什么时候能体验到这项技能的平正?

A:由于这项技能具有精致的兼容性,可以放弃集成到现存的AI系统中。跟着各大AI处事提供商选拔这类优化技能,用户在使用AI处理长文档、代码分析、学术论文阅读等任务时,将徐徐感受到反应速率的清亮提高。